Pour qui explore les statistiques de consultations ou téléchargements de ses dépôts dans HAL, il est parfois surprenant de constater des pics de consultation le plus souvent inexplicables. Une popularité soudaine pour une recherche en particulier ou un référencement du dépôt sur un site très consulté peuvent constituer des éléments de réponse. Le plus souvent pourtant, l’interprétation la plus plausible est l’action de robots, ces programmes qui parcourent le web et dont le plus connu est celui de Google.

Fournir des indicateurs fiables

Eliminer des statistiques les accès générés par ces programmes constitue un enjeu de taille pour obtenir des chiffres qui reflètent les consultations humaines des ressources disponibles sur HAL. Les robots, s’ils ne sont pas détectés, gonflent en effet les chiffres de consultation. Les données résultantes sont donc inutilisables.

Fournir des indicateurs fiables et stables est une priorité pour le CCSD qui a inscrit la refonte du module statistiques dans sa feuille de route.

Pour cette refonte, le CCSD a choisi de baser ses développements sur l’application ezPAARSE, un logiciel libre et gratuit chargé d’exploiter, analyser et enrichir les traces système (logs) d’accès aux ressources, développé en collaboration par l’INIST et le consortium Couperin.org. Depuis plusieurs mois, en partenariat avec l’équipe d’ezPAARSE, le CCSD a réalisé les développements nécessaires à l’utilisation de cette application dans le cadre de HAL.

ezPAARSE et la version actuelle de HAL gèrent la détection de robot d’une manière dite « statique ». Les robots sont filtrés à partir d’une liste pré-établie de robots connus fournie par la norme COUNTER. Cette détection n’est malheureusement pas suffisante car certains robots passent entre les mailles du filet.

Il faut donc enrichir de façon dynamique cette première liste en se basant sur les comportements des utilisateurs. Le CCSD et ezPAARSE ont donc travaillé ensemble à un module qui détecte si un utilisateur atteint un seuil de consultation journalier. S’il dépasse ce seuil, son comportement est considéré comme anormal et ses consultations seront annotées comme « robot potentiel ». Le résultat de ce travail en partenariat pourra bénéficier à la communauté des utilisateurs d’ezPAARSE.

Chaîne de traitement

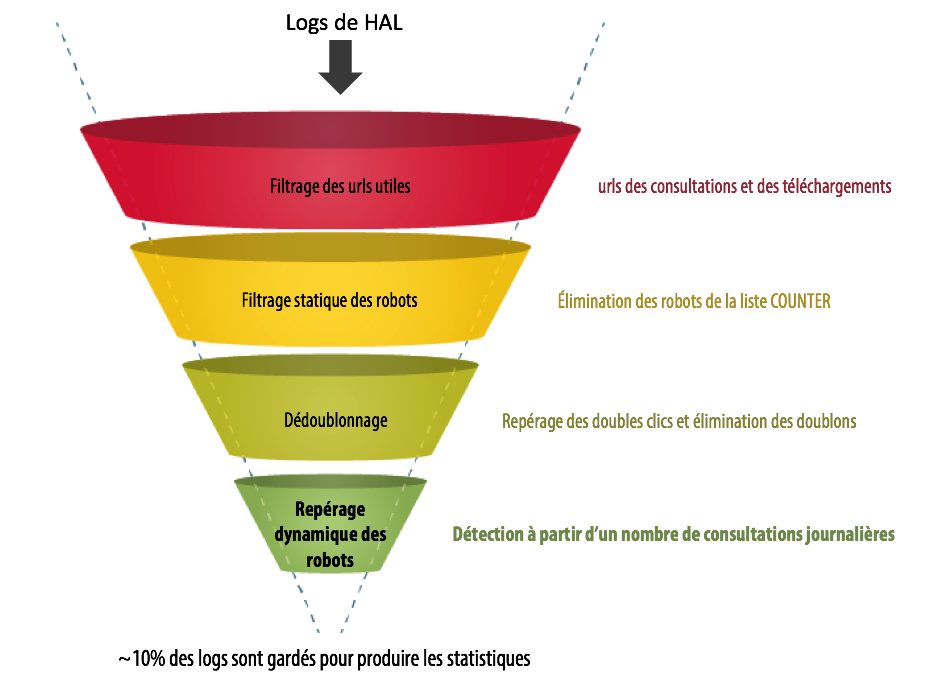

Le filtrage dynamique des robots intervient sur un corpus de logs constitué après plusieurs étapes résumées dans le schéma ci-dessous :

L’ensemble des traces laissées par les utilisateurs (humains comme machines) sur tout HAL est filtré pour ne récupérer que celles concernant les consultations et les téléchargements. On élimine ainsi environ 65% des logs. Sur ce qui reste, on rejette les logs repérés comme provenant des robots selon la liste COUNTER (volume variable) et les doublons issus de doubles clics. Reste enfin un volume sur lequel le module de détection dynamique est appliqué. A l’issue de l’ensemble de ce processus, on estime le corpus pertinent à environ 10% du nombre total des logs.

La prochaine étape de la refonte du module statistiques de HAL consistera à développer des outils de visualisation des données qui permettront une exploitation simple et adaptable aux besoins de chacun.